Färska globala tankar för orädda globala tänkare.

Välkommen till Where Possibilities Begin , G-P:s blogg som delar de senaste idéerna och insikterna från tillväxtinriktade innovatörer, företagsledare och branschledare från hela världen.

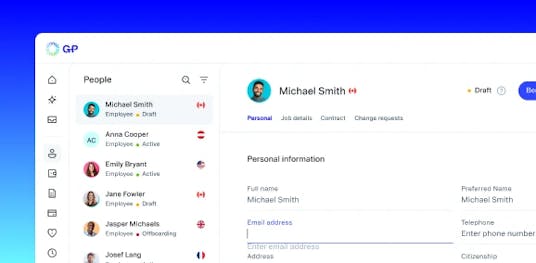

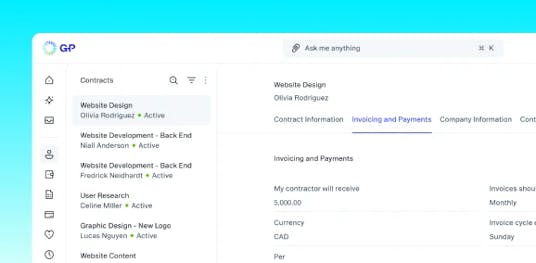

3 steg för att driva en global HR-avdelning på en SMB-budget

[Guide] Portage salarial i Frankrike

Hur G-P Gia™ blev en go-to resurs för ISTS

Vad är internationell HR outsourcing?

4 steg till AI-omvandling inom HR: Granska, automatisera, optimera, rapportera

Varför din bästa 2026 AI-strategi fortfarande är mänsklig

Geopolitisk smidighet: den nya HR-kompetensen för 2026

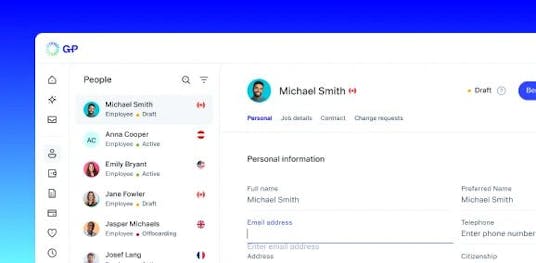

Vad är en global HRIS? En guide för internationell anställning

Toppländer för att anställa global IT-kompetens

Guide till hantering av HR-dokument

Guide till HR-automatisering i 2026

Globalt tankesätt. Global tillväxt. Nu kör vi.

länder tillgängliga

precision inom lönehantering

globala partner

kundnöjdhet

länder tillgängliga

precision inom lönehantering

globala partner

kundnöjdhet