في عام 2022، شرعنا في إعادة التفكير في استراتيجية البيانات الخاصة بنا. يتطلب الذكاء الاصطناعي التوليدي (GenAI) أساسًا متينًا للبيانات وواجهات برمجة التطبيقات. كان لدى G-P البصيرة لوضع أساس قوي مكننا من تشكيل مستقبلنا من خلال تحول مسؤول في الذكاء الاصطناعي.

نستخدم الذكاء الاصطناعي بمسؤولية

الامتثال على مستوى المؤسسة موجود في حمضنا النووي. بصفتنا روادًا في مجال الامتثال العالمي للتوظيف، فإننا معروفون بالتفكير العميق في كيفية حماية عملائنا. عندما نعتمد أدوات جديدة وننشئها، فإننا نراعي كل زاوية: القانونية والتوظيفية والسياسية والأمنية والمعمارية والهندسية والبيانات.

التحديث بالبيانات أولاً

عندما بدأنا رحلة التحديث، جعلنا المكونين هما حجر الزاوية لعمليتنا:

-

بنية مدفوعة بالمجال مع حساب AWS كحد. لكل سياق محدد حساب AWS خاص به لأن فريقًا واحدًا يمتلك ذلك السياق المحدد بالكامل. مع أي بنية موزعة، تكون معظم الاتصالات غير متزامنة وتعمل عبر الفعاليات. يمثل السياق المحدود قدرة الأعمال.

-

يحتوي Databrick’s Data Lakehouse على جميع البيانات المهيكلة وغير المهيكلة. نستوعب البيانات وننظفها من خلال عملية الترويج. يتم اعتماد البيانات الموجودة في فئتنا الذهبية، وتنظيفها، ووضع ملصقات عليها، والتحقق من صحتها. بينما تستمع البحيرة إلى الأحداث، يحدث الابتلاع بكفاءة دون جهد إضافي.

الآن، البيانات التي يتم استيعابها من الأحداث ليست ممتثلة ومهيكلة فحسب، ولكنها أيضًا جاهزة على الفور للرؤى والتطبيقات القائمة على الذكاء الاصطناعي. لقد أضفنا طابعًا ديمقراطيًا على البيانات من خلال مجموعة من منتجات البيانات التي يمكن استهلاكها في جميع أنحاء المؤسسة للذكاء الاصطناعي والوكلاء والتقارير والعمليات والمنتجات.

الابتكار يبدأ بالتجربة

يحدث الابتكار عندما يكون لكل شخص صوت. قدمنا هاكاثون الذكاء الاصطناعي السنوي في عام 2023 كمبادرة رئيسية. بالتأكيد، لدينا مختبر ذكاء اصطناعي مخصص، ولكن الابتكار لا يقع على عاتق فريق واحد. يمكن لكل فرد في المؤسسة (وليس الهندسة فقط) المشاركة والمساهمة بالأفكار.

يمنح GenAI الابتكار طابعًا ديمقراطيًا

بدأ أحدث منتج لدينا، G-P Gia™، كدخول ناجح في هاكاثوننا الافتتاحي. كانت الفرضية بسيطة: لدى قادة الموارد البشرية أسئلة حول الامتثال ويحتاجون إلى إجابات بسرعة. تتضمن الأسئلة الأكثر شيوعًا أكثر من 180 دولة نخدمها. كان الحل لهذه المشكلة هو استخدام بيانات الملكية الخاصة بنا لإنشاء نموذج ذكاء اصطناعي خاص بالشركة يمكنه الإجابة على أي استفسار.

Gia - وهاكاثوناتنا - هما مثالان رئيسيان على الاستخدام المسؤول للذكاء الاصطناعي عمليًا. لقد تمكنا من اختبار الأدوات واستكشاف تقنيات جديدة وتثقيف الموظفين جميعًا في وقت واحد. والأفضل من ذلك، أنه يمكننا التحكم في مجموعات البيانات وأن يكون لدينا خبراء داخليون في متناول اليد لمساعدة الموظفين.

يمكن أن يمثل الاستخدام المدروس للذكاء الاصطناعي تحديًا للمؤسسات أثناء التبني السريع. ستحتاج كل شركة إلى التنقل بين الاستخدام وتعلم كيفية حماية العملاء والموظفين وأصحاب المصلحة. أدت تجاربنا المبكرة إلى وجود حواجز الحماية التي توجهنا اليوم. الدرس الرئيسي: كن حذرًا بشأن الأدوات التي نستخدمها والبيانات التي نستخدمها للتدريب وكيفية دمجنا مع الأنظمة الحالية.

أداة الذكاء الاصطناعي المناسبة للوظيفة

في G-P، تستخدم بعض الأقسام خرائط واردلي للتركيز على المجالات الأكثر تأثيرًا لعملائنا. من المهم من خلال الابتكار التقني أن نفكر بشكل شامل في القدرة. وبالمثل، بدأنا رحلتنا مع الذكاء الاصطناعي قبل أن تطلق OpenAI ChatGPT، ولكننا نقلنا استخدامنا واختيار الأداة مع بدء جنون الذكاء الاصطناعي في التسارع.

وسرعان ما ظهرت أربع رؤى من التجربة:

-

سيصبح الابتكار اليوم سلعة الغد. لا فائدة من محاولة التنافس مع بائعي نماذج اللغة الكبيرة (LLM).

-

حافظي على صدقك مع كريم أساسك. بغض النظر عن المسار الذي يتخذه الذكاء الاصطناعي، تظل قيمنا الأساسية واحتياجات العملاء دون تغيير. نقوم بتشفير أساسنا ومعرفتنا بالبيانات وواجهات برمجة التطبيقات.

-

افصل الوكيل عن المساعد. يمكن للذكاء الاصطناعي إما مساعدة مستخدم في مهمة ما (مثل مساعد الطيار الذكي) أو العمل كوكيل يقوم بتنفيذ المهمة نيابة عنه. نفعل كلا الأمرين، لكننا لا نخلط بينهما.

-

اعتمد على المعايير، وليس على الأدوات. نغير الأدوات عندما لا تلبي احتياجاتنا. يُعد العمل وفقًا للمعايير ممارسة جيدة - ويحررنا من التجربة والابتكار.

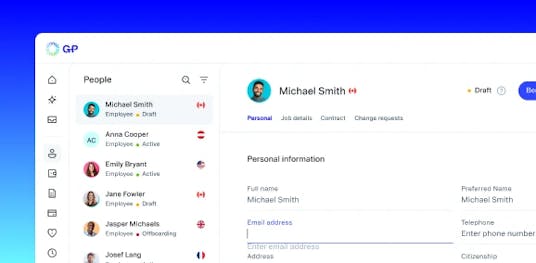

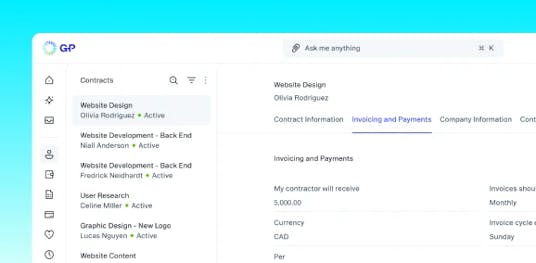

تختلف أدوات الذكاء الاصطناعي التي نستخدمها حسب الحاجة، ولكن يظل مبدأنا التوجيهي كما هو: العملاء لا يشترون الذكاء الاصطناعي منا. فهم يشترون تكنولوجيا الموارد البشرية غير الاحتكاكية (والمتوافقة).

الاعتماد المسؤول للذكاء الاصطناعي يبني الثقة

تتمثل قوة G-P في قدرتنا على التكيف وتفانينا في الامتثال - والعمل في مجال التكنولوجيا يتطلب التكيف المستمر. تساعدنا حواجز الحماية والاستخدام المتعمد على تبني الذكاء الاصطناعي وتقليل المخاطر بطرق تبني الثقة في المستخدمين والعملاء.

لقد تبنىنا الذكاء الاصطناعي دون أن يفوتنا أي إنجاز. هناك العديد من الشركات والأفراد الذين سيواجهون تحديات الذكاء الاصطناعي. مثل العديد من التقنيات، إنه مذهل، ولكنه ليس سحريًا. نحن نفهم بعمق كيف يعمل الذكاء الاصطناعي ونضع الأسس، مسبقًا، التي تسمح لنا بخلق أكبر قدر ممكن من القيمة لعملائنا.

شكّل استراتيجيتك حول الاستخدام المتعمد والمسؤول للذكاء الاصطناعي وستتمكن من الوصول إلى الابتكار والأدوات الموثوقة والنمو غير المغطى.